Объединив несколько иерархических структур, соответствующих разным сенсорным модальностям (под номером 1, рис. 3) со сформированными на них модальными моделями мира ![]() m, мы получим многомодальную модель мира:

m, мы получим многомодальную модель мира:

![]()

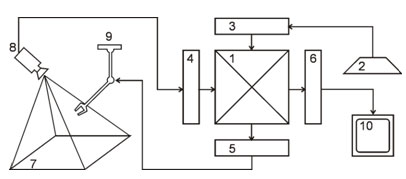

Рис. 3. Объединение иерархий для многомодального представления знаний в антураже задачи «Ханойская башня» (интегральный робот). Здесь (1) многомодальная иерархия из словарей разных уровней разных модальностей; (2) – клавиатура; (3) — сенсорная подсистема ввода текстовой информации; (4) — сенсорная подсистема ввода зрительной информации, предварительно обработанной и развернутой, полученной с модели сцены (7), наблюдаемой светочувствительной матрицей (8); (5) — эффекторная подсистема управления манипулятором (9); и (6) — эффекторная подсистема синтеза текста с выдачей на экран видеотерминала (10).

2.2 Формирование многомодального многоуровневого представления

Любое многомодальное представление можно рассматривать как квазитекстовое, поскольку оно имеет многоуровневую внутреннюю структуру. Поэтому, рассмотрим формирование такого представления у человека на примере обработки текстовой информации. Язык, представленный в виде множества текстов, с помощью описанного выше формализма подвергается статистическому анализу, в результате которого выявляются его словарные компоненты разных уровней.

При обработке текстов обычно рассматривается несколько уровней обработки информации: морфологический, лексический, синтаксический, а также – семантический и прагматический уровни. На каждом из уровней возможно формирование несколько словарей. Мы рассмотрим только некоторые из них. На морфологическом уровне – словарь флективных морфем. На лексическом уровне – словарь корневых основ. На синтаксическом уровне – словарь синтаксем, представляющих собой флективную структуру синтаксических узлов с выколотыми корневыми основами. На семантическом уровне – словарь попарной сочетаемости корневых основ [7]. На прагматическом – словарь элементарных цепочек смыслов (например, представленных расширенными предикатными структурами предложений) [8].

Рассмотрим последовательные этапы формирования вышеперечисленных словарей. Сначала формируется словарь флективных морфем {![]() }1, так как они являются наиболее часто встречающимися языковыми единицами.

}1, так как они являются наиболее часто встречающимися языковыми единицами.

На следующем этапе формируется словарь корневых основ слов. После того, как сформировался словарь флективных морфем, фильтрация словарем флективных морфем множества текстов приводит к формированию словаря корневых основ {![]() }2, так как в результате взаимодействия множества текстов со словарем флективных морфем возникает множество синтаксических последовательностей с купюрами вместо флексий, — множество последовательностей корневых основ.

}2, так как в результате взаимодействия множества текстов со словарем флективных морфем возникает множество синтаксических последовательностей с купюрами вместо флексий, — множество последовательностей корневых основ.

Далее формируется словарь синтаксического уровня {![]() }3. Этот словарь формируется фильтрацией через словарь корневых основ слов фрагментов текста, соответствующих по длине предложению. Полученные при этом цепочки флективных морфем – кластеризуются на подклассы по их графемной структуре. Эти подклассы являются частями синтаксических классов, соответствующих основным синтаксическим узлам.

}3. Этот словарь формируется фильтрацией через словарь корневых основ слов фрагментов текста, соответствующих по длине предложению. Полученные при этом цепочки флективных морфем – кластеризуются на подклассы по их графемной структуре. Эти подклассы являются частями синтаксических классов, соответствующих основным синтаксическим узлам.

После того, как сформирован словарь синтаксем, формируется словарь попарной (смысловой) сочетаемости слов [7] {![]() i}4, которая определяет семантику. Для простоты будем считать, что именно слова словарей этого уровня объединяются в семантическую сеть

i}4, которая определяет семантику. Для простоты будем считать, что именно слова словарей этого уровня объединяются в семантическую сеть ![]() :

:

![]() (26)

(26)

На прагматическом уровне формируется словарь {![]() i}5 элементарных цепочек смыслов предложений, которые могут быть выражены, например, расширенными предикатными структурами предложений pi:

i}5 элементарных цепочек смыслов предложений, которые могут быть выражены, например, расширенными предикатными структурами предложений pi:

![]() (26)

(26)

выстроенными в хвост друг другу. В общем случае и эти цепочки являются графами.

Конкретные ситуации в их развитии высвечиваются на семантической сети в виде последовательностей структур из слов. В рамках модели предметной области, представленной множеством ее описывающих текстов, такие цепочки разбиваются на классы, комбинации которых дают либо описания чего-либо, либо алгоритмы достижения чего-либо: знания описывающие (знания «о том, что» — пропозициональные знания, иными словами, убеждении, о природных явлениях и закономерностях) и знания предписывающие («о том как» — инструктивные или прескриптивные знания, которые можно называть технологиями) [9].

2.3 Модель мира. Языковой и многомодальные компоненты

Модель мира человека, таким образом, представляет собой совокупность модальных компонентов, которые объединяются в единое представление с помощью множества представлений о ситуациях, хранящихся в ламелях гиппокампа.

Однако существует более точно очерченная функциональность многомодальных компонентов модели мира, которая связана с латерализацией полушарий, зависящей от представительства в коре речевых функций. В субдоминантном (правом у правшей) полушарии локализован многомодальный образный компонент модели мира ![]() R, в доминантном (соответственно, левом у правшей) полушарии – многомодальный схематический

R, в доминантном (соответственно, левом у правшей) полушарии – многомодальный схематический ![]() L и лингвистический

L и лингвистический ![]() l компоненты модели. Такое распределение не случайно: социум через язык (через лингвистический компонент) как сегментирующую функцию, влияет на формирование левополушарного многомодального компонента. Все три компонента имеют поуровневые связи, и, потому, работают как единое целое:

l компоненты модели. Такое распределение не случайно: социум через язык (через лингвистический компонент) как сегментирующую функцию, влияет на формирование левополушарного многомодального компонента. Все три компонента имеют поуровневые связи, и, потому, работают как единое целое:

![]() (27)

(27)

Наряду с многомодальной схематической левополушарной (у правшей) моделью мира ![]() L, и параллельно ей, в левом полушарии формируется изоморфная многомодальной модели – лингвистическая модель мира

L, и параллельно ей, в левом полушарии формируется изоморфная многомодальной модели – лингвистическая модель мира ![]() l – также ассоциативная сеть ключевых понятий, соответствующих ключевым образам событий многомодальной модели. При этом схематические образы событий левополушарной многомодальной схематической модели

l – также ассоциативная сеть ключевых понятий, соответствующих ключевым образам событий многомодальной модели. При этом схематические образы событий левополушарной многомодальной схематической модели ![]() L наполняются содержанием – соответствующими образами событий правополушарной образной многомодальной модели

L наполняются содержанием – соответствующими образами событий правополушарной образной многомодальной модели ![]() R.

R.

Таким образом, многомодальная модель, представленная в виде объединенной семантической сети ![]() , имеет левополушарный языковой эквивалент (также в виде сети)

, имеет левополушарный языковой эквивалент (также в виде сети) ![]() l: многомодальным образам событий мира в их взаимосвязях в ней сопоставляются понятия (слова, словосочетания) с их соответствующими связями. Поэтому операции на языковой семантической сети можно считать отражением операций на образной сети (мы можем оценить операции над многомодальной моделью, моделируя их на лингвистической модели). И, вообще, лингвистический компонент модели мира можно считать изоморфным объединенному (право- и левополушарному) компонентам модели.

l: многомодальным образам событий мира в их взаимосвязях в ней сопоставляются понятия (слова, словосочетания) с их соответствующими связями. Поэтому операции на языковой семантической сети можно считать отражением операций на образной сети (мы можем оценить операции над многомодальной моделью, моделируя их на лингвистической модели). И, вообще, лингвистический компонент модели мира можно считать изоморфным объединенному (право- и левополушарному) компонентам модели.

Прагматические цепочки языкового представления различных ситуаций ![]() i (26) в совокупности формируют лингвистический компонент модели мира:

i (26) в совокупности формируют лингвистический компонент модели мира:

![]() (29)

(29)

также как ![]() объединение всех словарей всех уровней иерархии языкового представления, а аналогичные прагматические цепочки многомодальных представлений – формируют многомодальные компоненты

объединение всех словарей всех уровней иерархии языкового представления, а аналогичные прагматические цепочки многомодальных представлений – формируют многомодальные компоненты ![]() L и

L и ![]() R модели мира.

R модели мира.

2.4 Сравнение семантических сетей. Классификация

Поскольку далее нам придется выявлять смысл текстов их соотнесением с моделями предметных областей, рассмотрим вопросы сравнения текстов по смыслу и, далее, классификации текстов. Все, что будет сказано ниже, в равной степени относится к семантическим сетям, и прочим упоминавшимся выше конструкциям как в текстах (и квази-текстах), так и к когнитивным представлениям в многомерном (когнитивном) пространстве. Поэтому мы будем опускать знак (∧) над символами в случаях, если речь идет о текстах, и подразумевать его, если речь пойдет о структурах и операциях над ними в многомерном пространстве (которое моделируется колонками коры и ламелями гиппокампа).

Определение 6. Введем скалярное произведение на векторах ![]() , где угол между векторами понятий ci, cj: wij пропорционален весу связи от ci к cj: wij ∈ (0…900).

, где угол между векторами понятий ci, cj: wij пропорционален весу связи от ci к cj: wij ∈ (0…900).

Площадь треугольника Sj, построенного на векторах ![]() , развернутых на угол wij относительно друг друга будет использована для вычисления степени пересечения сначала звездочек, а потом семантических сетей как совокупностей звездочек.

, развернутых на угол wij относительно друг друга будет использована для вычисления степени пересечения сначала звездочек, а потом семантических сетей как совокупностей звездочек.

Определение 7. Под пересечением двух звездочек понимается сумма по всем событиям-ассоциантам данного главного события звездочки пересечений площадей двух треугольников, построенных в плоскости векторов ![]() , один из которых построен на векторах, развернутых на угол, пропорциональный связи (wij)1 между событиями в одной звездочке, а другой – на угол, пропорциональный связи (wij)2 между теми же событиями в другой, сравниваемой с первой, звездочке. В случае если в одной из звездочек пары, для которой считается пересечение, не нашлось соответствующего события-ассоцианта, пересечение считается равным 0.

, один из которых построен на векторах, развернутых на угол, пропорциональный связи (wij)1 между событиями в одной звездочке, а другой – на угол, пропорциональный связи (wij)2 между теми же событиями в другой, сравниваемой с первой, звездочке. В случае если в одной из звездочек пары, для которой считается пересечение, не нашлось соответствующего события-ассоцианта, пересечение считается равным 0.

![]() (29)

(29)

N1, N2 – число ассоциантов в звездочках, соответственно, 1 и 2.

Определение 8. Под пересечением семантических сетей понимается сумма пересечений звездочек, включенных в эти сети (считая по главным понятиям):

![]() (30)

(30)

M1, M2 – число звездочек, входящих, соответственно, в семантические сети 1 и 2.

Определение 9. В связи с этим, под классификацией входной ситуации можно понимать отнесение языковой семантической сети ситуации N к сети Nn (где n=1…N – число предметных областей) одной из предметных областей языковой семантической сети (языковой модели мира). В идеальном случае семантическая сеть ситуации вкладывается в сеть соответствующей предметной области.

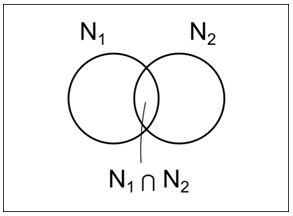

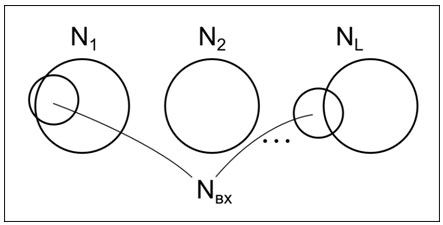

Используя операцию пересечения сетей N1 и N2, определенную выше, мы можем оценить степень подобия двух сетей N1 ∩ N2 (см. Рисунок 4), и тем самым, сравнивать по смыслу – по структуре – ситуации (их языковые модели). Имея модели предметных областей в виде ассоциативных семантических сетей, мы можем классифицировать входные ситуации (описывающие их языковые модели) вычислением степени совпадения (вложения) сети входной ситуации и сетей предметных областей (см. Рисунок 5), относя входную ситуацию к той предметной области, степень совпадения сети входной ситуации с сетью которой окажется больше.

Рисунок 4. Пересечение двух сетей N1 и N2, характеризующее степень их смыслового подобия.

Рисунок 5. Классификация входного текста путем выявления степени вложенности его семантической сети Nвх в одну или несколько семантических сетей классов-рубрик-предметных областей N1 , N2 … Nl.

Рисунок 5. Классификация входного текста путем выявления степени вложенности его семантической сети Nвх в одну или несколько семантических сетей классов-рубрик-предметных областей N1 , N2 … Nl.

Далее мы можем абстрагироваться от входных ситуаций. Будем рассматривать их языковые модели. Пойдем еще дальше: перейдем к анализу текстов, на основе которых эти языковые модели формируются. Как и в случае классификации входных ситуаций, используя операцию пересечения сетей, мы можем оценить степень подобия двух сетей, и тем самым, сравнивать по смыслу уже тексты. Имея модели предметных областей в виде ассоциативных семантических сетей соответствующих тематических текстовых выборок, мы можем классифицировать входные тексты вычислением степени совпадения (вложения) сети входного текста и сетей предметных областей, относя входной текст к той предметной области, степень совпадения его сети с сетью которой окажется больше.

Попробуем далее, используя все выше перечисленные знания, подойти к понятию сложности чего-либо: некоторого явления (например, ситуации) в виде последовательности взаимосвязанных многомодальных образов, то есть квази-текстов.

3 Сложность квази-текста как отражения некоторой ситуации

Как говорилось выше, особенностью применения нейроморфной ассоциативной памяти является необходимость и возможность использования как можно большего объема информации для оперирования с нею (в том числе, распознавания). С другой стороны, ассоциативная память обладает свойством эффективности хранения, что позволяет легко ориентироваться в соответствии входных потоков, и требуемых для их анализа и хранения ячеек памяти – то есть оценивать входные потоки, и, следовательно, управлять их сложностью.

Попробуем оценить сложность входной информации, учитывая количество модальностей m (отдельно выделим лингвистическое представление l), представленных в ней, количество формируемых уровней k словарей, количество словарей j на уровнях, количество слов i в словарях. Поскольку эта информация структурируется в процессе ее обработки в виде семантических сетей, удобно найти способ оценки ее сложности с учетом ключевых понятий сети, имеющих ранг выше заданного. Можно, например, определять количество существенно важных тем в семантической сети.

Определение 10. Под тематической структурой текста будем понимать минимальный древовидный подграф T = <K, C, R, D, W, V>, извлеченный из сети N, где в качестве корневой вершины берется вершина с максимальным рангом, а остальные вершины ранжируются в соответствие с их смысловыми весами. Здесь K – корневая вершина C – множество вершин в сети, R – множество связей этих вершин в семантической сети N, D – конкретный способ связей вершин в конкретной сети N, W и V – весовые характеристики вершин и связей, соответственно. Минимальный древовидный подграф получается удалением слабых связей V (ниже заданного порога hr), и слабых вершин (также ниже заданного порога hс).

Оперируя количествами тем, подтем и подподтем в тематических структурах текстов можно оценивать их сложность и сравнивать тексты по сложности. Поскольку любая вершина сети, а, следовательно, тематического графа тоже, имеет ближайших соседей-ассоциантов, которые являются ее семантическими признаками, по количеству ассоциантов можно определять сложность текста в ширину. А по количеству уровней подтем у главной темы – определять сложность текста в глубину.

Заключение

Первая из двух публикаций, посвященная формированию когнитивных сетей в мозге человека, и использованию технологии их формирования для анализа текстов, посвящена, в основном, теории когнитивных семантических сетей. Представленные механизмы формирования ассоциативных (однородных семантических) сетей, эффективны в обработке информации различной природы. В качестве примера такой обработки представлена обработка текстовой информации. Во второй части работы тезисно представлены соображения об анализе сложности текстового материала, которые будут подробно изложены во второй публикации.

Работа выполнена при поддержке РГНФ (проект №15-03-00860

«Методология управления сетевыми структурами в контексте парадигмы сложности»)

Литература

- DARPA SyNAPSE Program http://www.artificialbrains.com/darpa-synapse-program

- Евин И.А., Кобляков А.А. Сети, которые хранятся в нашей памяти ( Когнитивные сети) https://spkurdyumov.ru/networks/seti-kotorye-xranyatsya-v-nashej-pamyati/

- Харламов А.А. Нейросетевая технология представления и обработки информации (естественное представление знаний). — М.: «Радиотехника», 2006.

- Корнеев И.Л., Гришин А.Г. СБИС для цифрового согласованного фильтра Элетроника: наука, технология, бизнес. Февраль 2008. Стр. 54-57.

- Hopfield, J.J. Neural networks and physical systems with emergent collective computational abilities. Proc. Natl. Acad. Sci. 79, 1982. Pp. 2554 – 2558.

- Brown T.H., Zador A.M. Hippocampus. In G.M.Shepherd (Ed.), The synaptic organisation of the brain. New York, Oxford: Oxford University Press, 1990. Pp. 346 — 388

- Рахилина Е.В. Когнитивный анализ предметных имен: семантика и сочетаемость. М.: Русские словари, 2000.

- Alexander A. Kharlamov, Tatyana V. Yermolenko, Andrey A. Zhonin Text Understanding as Interpretation of Predicative Structure Strings of Main Text’s Sentences as Result of Pragmatic Analysis (Combination of Linguistic and Statistic Approaches)// Доклад на Международной конференции SPECOM 2013, Пльзень, Чехия, сентябрь 2013г. – Pp. 333-339

- Мокир Дж. Дары Афины. Исторические истоки экономики знаний. М. Изд-во Института Гайдара 2012.